Entdecken Sie, wie KI automatisch fesselnde Momente aus langen Videos erkennt und extrahiert. Sparen Sie 200+ Stunden pro Jahr mit intelligenten Clipping-Tools für TikTok, Reels und Shorts.

Einleitung zum Blogbeitrag

Du hast gerade eine 90-minütige Podcast-Folge, ein Webinar oder einen Livestream aufgenommen. Darin verstecken sich Dutzende Momente, die viral gehen könnten und perfekt für TikTok, Instagram Reels und YouTube Shorts geeignet sind. Aber hier kommt der Haken—diese Highlights manuell zu finden und sie in polierte Clips zu verwandeln? Das sind schnell 10-15 Stunden Arbeit, die du wahrscheinlich in dieser Woche nicht hast.

Was würde sich ändern, wenn wir dir sagen, dass du das gar nicht tun musst?

KI-gestützte Video-Clipping-Tools scannen nun automatisch längere Inhalte, erkennen spannende Momente anhand von Audio-Signalen und visuellen Mustern und generieren plattformoptimierte Short-Clips in unter 5 Minuten. Wir sprechen von Zeiteinsparungen bis zu 200 Stunden pro Jahr und einer durchschnittlichen Steigerung der Engagement-Rate um 12%—ganz ohne deine aktive Beteiligung.

Aber hier ist, was die meisten Creator nicht wissen: Nicht alle KI-Clipping-Tools sind gleich. Manche funktionieren hervorragend bei Podcast-Inhalten, scheitern aber kläglich bei Livestreams. Andere verpassen die subtilen Momente, die tatsächlich Shares generieren. Und viele Creator verschwenden Zeit mit unhandlichen Workflows, die am Ende langsamer sind als manuelle Arbeit.

In diesem Guide durchschauen wir den ganzen Hype. Du erfährst genau, wie KI-Moment-Erkennung tatsächlich funktioniert, welche Tools echte Ergebnisse für deinen Content-Typ liefern, und wie du einen Clipping-Workflow aufbaust, der von deinem ersten Upload bis zur Verteilung auf jede Plattform skalierbar ist. Lass uns anfangen.

Jetzt, da du weißt, was möglich ist, sprechen wir über die Magie dahinter—denn bevor du diese goldenen Momente extrahieren kannst, musst du verstehen, wie KI sie überhaupt findet. Bereit, einen Blick unter die Haube zu werfen?

Wie KI fesselnde Momente in langen Videos erkennt

Du hast Stunden an Rohmaterial, und irgendwo darin steckt der nächste virale Clip. Die Frage ist: Wie findet KI ihn eigentlich? Moderne Algorithmen zur Momentenerkennung arbeiten wie hochtrainierte Redakteure unter Koffeineinfluss – sie scannen, analysieren und kennzeichnen die Goldstücke in Sekunden. Anstatt dein gesamtes Video zufällig durchzuschauen, nutzt KI eine Kombination aus Audioanalyse, visuelle Erkennung und Mustererkennung, trainiert an tausenden viralen Clips, um genau zu lokalisieren, wo die Magie passiert.

AI-Algorithmen zur Momentenerkennung verstehen

KI-gestützte Clipping-Tools analysieren mehrere Signalschichten gleichzeitig. Laut Opus funktioniert die Momentenerkennung durch die Untersuchung von Sprecherbetonung, Tempo-Veränderungen, Gelächter, Stille-Pausen und emotionalen Tonwechseln in deiner Audiospur. Wenn der Host plötzlich die Stimme hebt, in eine nachdenkliche Pause verfällt oder der Raum in Gelächter ausbricht, erkennt der Algorithmus diese Verschiebungen als potenzielle Engagement-Spitzen.

Das System hört nicht nur hin – es schaut auch hin. Computer-Vision-Komponenten identifizieren Gesichtsausdrücke, Text-Overlays auf dem Bildschirm, Szenenwechsel und visuelle Engagement-Spitzen. Denk darüber nach: Wenn jemandem die Augen vor Überraschung aufgehen oder der Mund herunterfällt, das ist ein Moment, der es wert ist, geclippt zu werden. Text auf dem Bildschirm, animierte Grafiken, die auftauchen, oder schnelle Kamerawechsel signalisieren alle Inhalte, die Aufmerksamkeit erregen sollen.

Pro-Tipp: Die besten KI-Clipping-Tools kombinieren mehrere Erkennungsmethoden, anstatt sich auf ein einzelnes Signal zu verlassen. Dieser mehrschichtige Ansatz erfasst Momente, die reine Audio-Analyse oder visuelle Erkennung übersehen würde.

Was macht einen Moment nach Meinung der KI viral?

Hier wird es faszinierend: KI-Modelle, trainiert an tausenden viralen Clips über verschiedene Plattformen hinweg, haben gelernt, universelle Muster zu erkennen, die Aufmerksamkeit greifen. Dies sind keine willkürlichen Regeln – sie sind Muster, die aus Inhalten extrahiert wurden, die tatsächlich auf TikTok, Instagram Reels, YouTube Shorts und anderen Plattformen gut performen.

Forschung von Klap betont, dass das System Füller-Inhalte filtert und Momente mit hoher Engagement-Wahrscheinlichkeit kennzeichnet, indem es gegen Benchmarks erfolgreicher Clips verglichen wird. Aber hier ist die Nuance: Was in einem Comedy-Podcast viral geht, unterscheidet sich von dem, was in einem Bildungskanal einschlägt. Deshalb passen sich Algorithmen an verschiedene Inhaltstypen an. Interviews heben Schlüsselzitate und überraschende Aussagen hervor. Bildungsinhalte betonen klare Erklärungen und „Aha-Momente". Entertainment-Clips priorisieren Reaktionen, Ausdrücke und Comedy-Timing.

Wichtiger Punkt: KI erkennt nicht nur Momente – sie versteht Kontext und Plattform-Dynamiken, was bedeutet, dass sie Empfehlungen auf deinen spezifischen Inhaltstyp und dein Publikum zuschneiden kann.

Warum Audio- und Bildzeichen wichtig sind

Weder Audio noch Bilder allein erzählen die komplette Geschichte. Aber wenn du sie kombinierst? Das ist der Punkt, an dem die Engagement-Erkennung kraftvoll wird. Die Stimme eines Sprechers könnte sich verschieben, um anzudeuten, dass er etwas Wichtiges fallen lässt, während sein Gesichtsausdruck verstärkt, dass dies ein entscheidender Moment ist, der es zu erfassen gilt.

Die Synergie zwischen diesen Signalen ist das, was modernes KI-Clipping so effektiv macht. Ein plötzliches Gelächter ohne visuelle Reaktion könnte nur ein leichtes Kichern sein. Aber Gelächter kombiniert mit jemandem, dessen Gesicht aufleuchtet, und einer Bildschirm-Unterschrift, die auftaucht? Das ist ein garantierter Engagement-Moment. Durch die gemeinsame Verarbeitung von Audio- und visuellen Informationen erreicht KI, was früher Stunden manueller Überprüfung brauchte – die Identifizierung von Dutzenden clippbarer Momente in einem einzigen Durchgang.

- KI analysiert Sprecherton, Tempo und emotionale Verschiebungen in Audio

- Computer Vision identifiziert Gesichtsausdrücke und visuelle Übergänge

- Multi-Signal-Analyse erfasst Momente, die Single-Detection-Methoden verpassen würden

- Algorithmen lernen von viralen Content-Mustern über Plattformen hinweg

- Die Erkennung passt sich deinem spezifischen Inhaltstyp und Publikum an

Nachdem du jetzt verstanden hast, wie fortgeschrittene Erkennung funktioniert, um deine Content-Strategie scharf zu halten, lassen uns die Tools erkunden, die tatsächlich diese viralen Clips erstellen können. Wir haben die Top-KI-Clip-Generatoren auf dem Markt getestet, und wir sind bereit, dir zu zeigen, welche einen Platz in deinem Content-Toolkit verdienen.

Die besten KI-Clip-Generator-Tools im Vergleich

Die Wahl des richtigen KI-Schnitt-Tools hängt von deinem Content-Typ, deinem Workflow und deinen Plattformzielen ab. Schauen wir uns die herausragenden Optionen an und was jedes Tool für verschiedene Creator besonders macht.

Top-Tools nach Anwendungsfall

OpusClip führt das Feld an für Creator, die virale Momente jagen. Nach Opus analysiert die Plattform Trend-Muster und Viewer-Engagement-Signale, um automatisch die am meisten teilbaren Segmente in deinem Content zu identifizieren. Das macht es perfekt, wenn du lange Podcasts oder Interviews produzierst, bei denen Authentizität Viralität fördert.

StreamYard glänzt für Live-Content-Creator. Anstatt später durch Aufzeichnungen zu wühlen, kannst du während deines Livestreams buchstäblich sagen „clip that", und die Plattform markiert den Moment in Echtzeit. Dieser freihändige Ansatz verkürzt die Nachbearbeitung drastisch.

VEED zeichnet sich durch Nachbearbeitungs-Finish aus und bietet automatische Untertitelgenerierung und Multi-Format-Export in einem Workflow. Perfekt für Creator, die polierte, professionell aussehende Clips wollen, ohne sich mit mehreren Tools herumzuschlagen.

Munch AI spezialisiert sich auf Long-Form-Content wie Podcasts und Webinare und extrahiert automatisch Schlüsselzitate und Diskussionspunkte, die natürlicherweise als eigenständige Clips funktionieren. Cutlabs spart über 4 Stunden wöchentlich, indem es Videos bis zu 8 Stunden Länge unterstützt mit sofortiger Momentensuche – ideal für Webinar-Hosts und Podcast-Netzwerke.

Profi-Tipp: Teste 2–3 Tools mit deinem echten Content, bevor du dich festlegst. Der KI-„Geschmack" jedes Tools variiert leicht je nach seinen Trainingsdaten.

Geschwindigkeit und Automatisierungs-Features

Forschung von Klap zeigt, dass die Automatisierungstiefe zwischen den Plattformen erheblich variiert. Einige Tools erfordern es, dass du KI-Vorschläge überprüfst, bevor du Clips finalisierst, während andere polierte, postfertige Inhalte in unter 5 Minuten liefern.

Der Geschwindigkeitsvorteil kommt darauf an, wie viel die KI ohne menschliches Eingreifen bewältigt. Tools, die automatisch Untertitel generieren, Übergänge hinzufügen und Brand-Farben anwenden, sparen dir die meiste Zeit. Wenn du wöchentlich mehrere Videos verarbeitest, summiert sich das zu echten Zeitersparnissen.

Plattformoptimierungs-Fähigkeiten

Jedes Tool handhabt plattformspezifische Formatierung unterschiedlich – und das richtig zu machen ist entscheidend. TikTok verlangt vertikale (9:16) Seitenverhältnisse, Instagram Reels funktionieren am besten bei 1:1 Quadrat, während YouTube Shorts 16:9 Breitbildformat bevorzugen. Die besten Tools ändern automatisch Größe und Ausschnitt deiner Clips für jede Plattform ohne Qualitätsverlust.

Wichtiger Punkt: Einige Tools exportieren Clips gleichzeitig in allen drei Formaten, während andere manuelle Auswahl erfordern. Das macht einen riesigen Unterschied, wenn du ein langes Video über mehrere Plattformen hinweg wiederverwendest.

Jetzt, da du weißt, worauf du in einem Tool achten musst, gehen wir schrittweise durch, wie du einen effizienten Workflow von Anfang bis Ende aufbaust. Ich zeige dir, wie du diese Features nutzt, um ein Video in nur wenigen Schritten in ein Multi-Plattform-Kraftpaket zu verwandeln.

Schritt-für-Schritt-Workflow: Von Upload bis Veröffentlichung

Jetzt, da Sie Ihr KI-Clipping-Tool ausgewählt haben und verstehen, wie die Technologie funktioniert, ist es Zeit, sie in die Praxis umzusetzen. Das Schöne an modernen KI-Clip-Generatoren ist, dass der gesamte Workflow – vom Upload Ihres Long-Form-Inhalts bis zur Veröffentlichung auf mehreren Plattformen – überraschend unkompliziert ist. Lassen Sie uns jede Phase durchgehen, damit Sie Ihre 90-Minuten-Podcasts und Webinare in Minuten statt Stunden in virale Clips umwandeln können.

Video hochladen und verarbeiten

Der Einstieg ist so einfach wie Drag-and-Drop. Die meisten KI-Clipping-Tools unterstützen Videodateien bis zu 8 Stunden Länge, was alles von Podcasts und Webinaren bis zu Livestreams und Konferenzaufzeichnungen abdeckt. Nach dem Upload beginnt die KI sofort, Ihren Inhalt zu scannen – kein Warten auf Verarbeitungswarteschlangen, die Tage dauern.

Laut Opus können moderne KI-Tools innerhalb von Minuten 10–30 Clip-Vorschläge generieren, indem sie Audiomuster, Sprecherenergien, Publikumsreaktionen und visuelle Übergänge analysieren. Diese Automatisierung eliminiert das mühsame Scrubben über die Zeitachse, das früher Stunden von Editorenzeit verbrauchte. Ihre Aufgabe in dieser Phase? Einfach warten. Die KI erledigt die schwere Arbeit.

Profi-Tipp: Laden Sie während der Stoßzeiten aus, wenn Ihr Tool Verarbeitungsgeschwindigkeit anzeigt. Einige Plattformen priorisieren Uploads basierend auf der Serverauslastung.

Von KI generierte Clips überprüfen und anpassen

Hier zeigt sich menschliches Urteilsvermögen. Die KI hat den Scan durchgeführt, aber jetzt werden Sie zum Kurator. Überprüfen Sie die vorgeschlagenen Clips und wählen Sie die Momente aus, die wirklich mit Ihrer Marke und Ihrem Publikum resonieren. Das ist entscheidend – während KI bemerkenswert gut darin ist, Engagement-Spitzen zu erkennen (Tonstärkeshift, Gelächter, Applaus), kann sie Kontext oder Ihre spezifische Content-Strategie nicht immer verstehen.

Wie von Klap hervorgehoben, ist der wirkungsvollste Ansatz eine Kombination aus KI-Erkennung und menschlicher Kuratierung. Sie könnten feststellen, dass die KI einen lustigen Moment markiert hat, aber die anschließende Pointe, die eigentlich besser landet, übersehen hat. Das ist Ihr Moment, um manuelle Anpassungen vorzunehmen. Nachdem Sie Ihre Top-Clips ausgewählt haben, passen Sie jeden Clip mit gebrandeten Intros, angepassten Untertiteln und auf Plattformvorgaben zugeschnittenen Längen an.

Wichtiger Punkt: KI übersieht selten die offensichtlichen Engagement-Spitzen, aber menschliche Augen erkennen die Nuancen, die Clips wirklich viral machen.

Optimierung für mehrere Plattformen

Unterschiedliche Plattformen haben unterschiedliche Anforderungen. TikTok belohnt schnelllebige, vertikale 15–60-Sekunden-Clips. Instagram Reels bevorzugen ähnliche Formate, aber mit etwas anderen Seitenverhältnissen. YouTube Shorts funktionieren am besten bei 15–60 Sekunden in vertikaler Ausrichtung. LinkedIn verlangt einen professionelleren Ton und etwas längere Segmente (30–90 Sekunden).

Anstatt jeden Clip für jede Plattform manuell neu zu bearbeiten, ermöglichen es Ihnen moderne KI-Tools, Clips für mehrere Formate gleichzeitig zu optimieren. Sie passen Untertitel einmal an, legen Ihre Branding-Richtlinien einmal fest, und das Tool formatiert automatisch neu für die Vorgaben jeder Plattform. Hier beschleunigt sich Ihr Workflow dramatisch – was früher 3–4 Stunden dauerte, dauert jetzt 10 Minuten.

- Wählen Sie Ihre Zielplattformen aus (TikTok, Instagram, YouTube Shorts, LinkedIn usw.)

- Legen Sie plattformspezifische Clip-Längenvorgaben fest

- Wenden Sie einheitliches Branding auf alle Formate an

- Überprüfen Sie automatisch generierte Untertitel auf Genauigkeit

- Passen Sie das Tempo an und schneiden Sie bei Bedarf

Direkte Veröffentlichung auf Social Channels

Der letzte Schritt ist in seiner Einfachheit fast antiklimaktisch. Die meisten modernen KI-Clipping-Tools bieten One-Click-Multi-Plattform-Veröffentlichung, was bedeutet, dass Sie Ihre polierten Clips direkt an TikTok, Instagram, YouTube und LinkedIn senden können, ohne das Tool jemals zu verlassen. Kein Herunterladen, kein Wechsel zwischen Apps, kein mehrfaches Hochladen von Dateien.

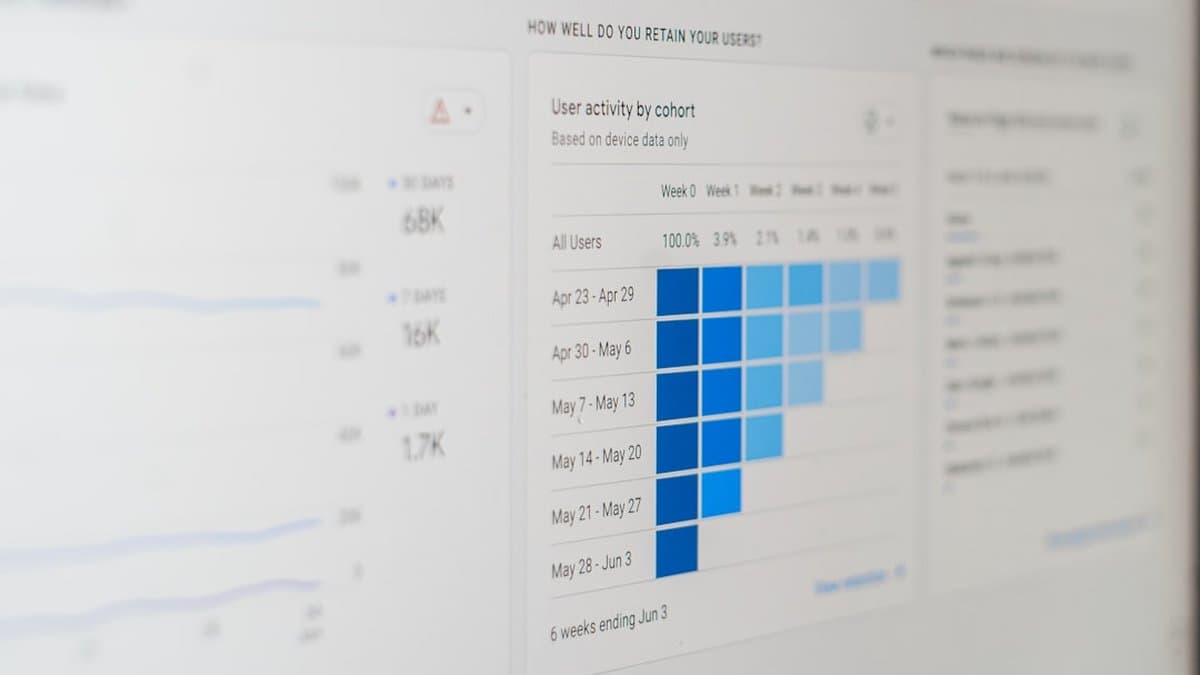

Nach der Veröffentlichung verfolgen Sie Leistungsmetriken, um zu sehen, welche von der KI ausgewählten Momente tatsächlich Engagement auf jeder Plattform fördern. Dieser Feedback-Loop ist unbezahlbar – im Laufe der Zeit werden Sie anfangen zu verstehen, auf welche Arten von Clips Ihr Publikum reagiert, und Sie können diese Erkenntnisse zurück in Ihre Content-Strategie für zukünftige Long-Form-Aufnahmen einbringen.

Warnung: Überprüfen Sie Untertitel und Branding immer ein letztes Mal, bevor Sie veröffentlichen. Automatisierte Systeme interpretieren manchmal Audioqualität oder Kontext falsch, und Sie möchten, dass Ihre Clips poliert sind, bevor sie live gehen.

Jetzt, da Sie Ihre einzelnen Clips poliert und bereit haben, sprechen wir darüber, wie Sie dieses gleiche Qualitätsniveau über all Ihren Inhalt beibehalten, wenn Sie anfangen, mehr zu produzieren. Wir werden einige praktische Systeme und Strategien erkunden, die Ihnen helfen, Ihre Markenstimme und Videostandards beizubehalten, auch wenn Sie mehrere Projekte gleichzeitig jugglieren.

Qualität und Markenkonsistenz in großem Maßstab bewahren

Hier ist die Realität: KI ist unglaublich mächtig beim Erkennen fesselnder Momente, aber du bist immer noch der Chef. Die besten Creator akzeptieren nicht einfach, was der Algorithmus generiert – sie nutzen KI als kreativen Partner, der die schwere Arbeit übernimmt, während sie die vollständige kreative Kontrolle behalten. Wenn du pro Monat Dutzende von Videos schneidest, wird dieser hybride Ansatz unverzichtbar, um in großem Maßstab zu wachsen, ohne das aufzugeben, was deine Marke einzigartig macht.

Der Mensch-KI-Hybrid-Ansatz

Denke von KI-Momentenerkennung als deinen unermüdlichen Forschungsassistenten. Sie beobachtet jede Sekunde deines Materials, kennzeichnet potenzielle Clips und präsentiert sie dir zur Überprüfung. Aber hier kommt deine Expertise ins Spiel: du entscheidest, was tatsächlich veröffentlicht wird. Laut Async halten Creator, die diesen Review-und-Genehmigungsworkflow implementieren, signifikant höhere Qualitätsstandards in ihren Content-Bibliotheken, während sie gleichzeitig die Produktionszeit dramatisch reduzieren.

Der Workflow ist unkompliziert. Nachdem KI Clip-Vorschläge generiert hat, nimm dir 15-20 Minuten Zeit, um sie mit frischem Blick zu überprüfen. Stellen dir selbst diese Fragen: Repräsentiert dieser Clip meine Marke genau? Ist der Sound klar? Hat er einen starken Hook in den ersten drei Sekunden? Passt er zu den Erwartungen meines Publikums? Dieses schnelle Qualitäts-Gate verhindert, dass mittelmäßige Inhalte deinem Ruf schaden, selbst wenn du in großem Maßstab produzierst.

Pro-Tipp: Bündele deine Review-Sitzungen in dedizierte Zeitblöcke, anstatt den ganzen Tag über Clips zu überprüfen. Du wirst schneller und konsistentere Entscheidungen treffen, wenn du im „Bearbeitungsmodus" bist.

Benutzerdefinierte Erkennungsparameter einrichten

Nicht alle Inhalte sind gleich, und deine KI-Einstellungen sollten es auch nicht sein. Eine motivierende Rede erfordert andere Schnitt-Empfindlichkeit als ein Comedy-Podcast – einer könnte längere, nachdenklichere Momente benötigen, während der andere von schnellen Pointen lebt. Laut Opus ist das Anpassen von Erkennungsparametern basierend auf deinem Content-Typ eines der am wenigsten genutzten Features, auf das Creator Zugriff haben.

Beginne damit, mit Empfindlichkeitsstufen zu experimentieren. Bildungsinhalte profitieren oft von mittlerer Empfindlichkeit (Erfassung jener „Aha!"-Momente ohne zu viel zu schneiden), während Unterhaltungsinhalte möglicherweise hohe Empfindlichkeit nutzen, um jeden Lacher und jede Reaktion einzufangen. Neben Empfindlichkeit kannst du folgendes anpassen:

- Mindestlänge des Clips (z. B. 15–60 Sekunden je nach Plattform)

- Maximale Clip-Länge zur Vermeidung von schweifenden Segmenten

- Schlüsselwort-Ausschlüsse (Clips mit Erwähnungen von Konkurrentennamen oder sensiblen Themen ausschließen)

- Topic-Filter (Clips über dein Kernthema priorisieren)

- Audio-Qualitätsschwellen (Clips mit Hintergrundgeräuschen über bestimmten Pegeln ablehnen)

Verbringe einen Nachmittag damit, diese Einstellungen an 2–3 repräsentativen Videos zu testen. Wenn du deinen Sweet Spot gefunden hast, speichere diese Konfigurationen als Templates, die du bei zukünftigen Uploads in Sekunden anwenden kannst.

Wichtiger Punkt: Deine Erkennungsparameter sollten sich entwickeln, wenn dein Publikum und deine Marke wachsen. Überprüfe und passe sie vierteljährlich basierend auf Engagement-Raten der Clips an.

Eine Inhalt-Qualitätscheckliste erstellen

Konsistenz ist die geheime Zutat, die Marken, denen die Leute vertrauen, von verstreut wirkenden unterscheidet. Wenn du wöchentlich mehrere Clips produzierst, verhindert eine detaillierte Qualitätscheckliste Abweichungen. Deine Checkliste sollte jedes visuelle, Audio- und Messaging-Element abdecken, das deine Marke definiert.

Erstelle ein Dokument, das folgendes enthält:

- Intro-/Outro-Stile: Nutzt du immer dieselbe 3-Sekunden-Grafik? Dieselbe Hintergrundmusik?

- Farbkalibrierung: Nutzen alle Clips dasselbe LUT (Look-Up Table) oder Farbprofil?

- Untertitel-Formatierung: Konsistente Schriftart, Größe, Farbe und Positionierung in allen Clips

- Musikauswahl: Genehmigte Track-Bibliothek mit bestätigter Lizenzierung

- Messaging-Ton: Brand-Voice-Richtlinien (formell vs. casual, Humorgrad, Vokabular)

- Call-to-Action-Standards: Wo CTAs erscheinen, was sie sagen, visuelles Design

Vor der Veröffentlichung eines Clips überprüfe ihn mit dieser Checkliste. Das dauert 60 Sekunden und verhindert den „Das sieht nicht nach unserer Marke aus"-Moment, der das Vertrauen der Zuschauer zerstört.

Warnung: Die Checkliste zu überspringen, um Zeit zu sparen, geht fast immer nach hinten los. Inkonsistente Markenführung lässt deine gesamte Content-Bibliothek weniger professionell wirken, selbst wenn einzelne Clips großartig sind.

Eine letzte Strategie: verarbeite mehrere Videos gleichzeitig in Batches. Lade 5–10 Videos auf einmal in dein KI-Tool hoch, lass sie über Nacht alle verarbeiten und verbringe dann 2–3 Stunden am nächsten Morgen damit, alle generierten Clips zu überprüfen und deine Checkliste anzuwenden. Dieser Workflow schlägt einzelne Video-Verarbeitung, weil du in einem fokussierten, effizienten Geisteszustand bist.

Verwirf abgelehnte

Kostenanalyse: Kostenlose vs. kostenpflichtige Tools und ROI-Überlegungen

Die entscheidende Frage lautet: Macht ein Upgrade wirklich aus wirtschaftlicher Sicht Sinn für deinen Workflow? Die Antwort hängt von deinem Content-Volumen, deiner Veröffentlichungshäufigkeit und dem Wert, den du deiner Zeit beimaßt, ab. Lassen Sie uns die Zahlen durchgehen, damit Sie eine Entscheidung treffen können, die tatsächlich für Ihr Geschäft zählt.

Einschränkungen der kostenlosen Stufe

Kostenlose KI-Clip-Generatoren klingen großartig, bis Sie an ihre Grenzen stoßen. Laut Opus erzeugen kostenlose Tools wie bestimmte Versionen von VEED und OpusClip typischerweise nur 3–5 Clips monatlich mit Wasserzeichen, die über dein Video gestempelt werden – ein No-Go, wenn du versuchen möchtest, eine professionelle Marke zu bewahren. Sie werden auch auf begrenzte Anpassungsmöglichkeiten, langsamere Verarbeitungszeiten und minimale Analysen stoßen, um zu verstehen, was wirklich funktioniert.

Das Wasserzeichen-Problem allein kann deine Glaubwürdigkeit untergraben. Kostenlose Tools beschränken auch, wohin du Clips exportieren kannst, und setzen oft Limits für deine Video-Upload-Länge oder Dateigröße. Für gelegentliche Content-Creator, die das Wasser testen, könnten diese Einschränkungen tolerierbar sein. Aber sobald du es ernst mit dem Skalieren meinst, wirst du die Grenzen spüren.

Warnung: Wasserzeichen in der kostenlosen Stufe können deiner professionellen Glaubwürdigkeit ernsthaft schaden, besonders wenn du bei Kunden pitchst oder eine Personal Brand aufbaust.

Kostenpflichtige Pläne und Preismodelle

Kostenpflichtige Pläne kosten in der Regel 20–99 EUR monatlich, je nach Plattform und Funktionsumfang. Auf diesem Level freischaltest du unbegrenzte Clip-Generierung, bevorzugte Verarbeitungsgeschwindigkeiten, erweiterte Analytics-Dashboards und White-Label-Optionen, die alle Branding-Elemente entfernen. Forschungen von Oreate AI zeigen, dass Mid-Tier-Tools in der kostenpflichtigen Kategorie für die meisten Creator und kleine Agenturen der optimale Punkt sind – sie bieten ernsthafte Funktionalität ohne Enterprise-Preise.

Wenn du mehrere Creator-Konten verwaltest oder zentralisierte Genehmigungsworkflows benötigst, bieten Enterprise-Lösungen (500+ EUR/Monat) anpassbare Integrationen und dedizierten Support. Der Preissprung entspricht dem Maßstab – diese Pläne verarbeiten 50+ Clips wöchentlich über verschiedene Teamangehörige.

Kostenlos

3–5 Clips/Monat Mit Wasserzeichen Grundfunktionen Eingeschränkter Support

Standard kostenpflichtig

20–99 EUR/Monat Unbegrenzte Clips Erweiterte Analysen Bevorzugte Verarbeitung

Enterprise

500+ EUR/Monat Teamverwaltung Benutzerdefinierte Workflows Dedizierter Support

Berechnung deiner Zeitersparnis-ROI

Hier wird die Rechnung überzeugend. Wenn KI dir 4 Stunden wöchentlich spart – Zeit, die du sonst mit manueller Bearbeitung und dem Exportieren von Clips verbringst – ergibt das ungefähr 160–400 EUR monatlich an zurückgewonnener Zeit, abhängig von deinem Freelance- oder Creator-Stundensatz. Die meisten kostenpflichtigen Tools zahlen sich allein durch Zeiteinsparungen in einem einzelnen Monat aus.

Nehmen wir an, du bist ein Freelancer mit 50 EUR/Stunde Satz und ein kostenpflichtiges Tool kostet 50 EUR/Monat. Wenn es dir auch nur eine Stunde pro Woche spart, hast du die Kosten gedeckt. Jede weitere Zeiteinsparnis ist reiner Gewinn. Für Creator, die 10+ Clips wöchentlich veröffentlichen, ist ein Upgrade nicht optional – es ist essenziell für deine Workflow-Effizienz.

Profi-Tipp: Berechne deinen Stundensatz, multipliziere ihn mit den wöchentlichen Stunden, die du sparst, und vergleiche das mit den monatlichen Tool-Kosten. Wenn die gesparten Stunden die Gebühr übersteigen, upgraden Sie sofort.

Die Gleichung ist einfach: gelegentliche Publisher (weniger als 5 Clips wöchentlich) können bequem bei kostenlosen Optionen bleiben, während aktive Content-Creator in kostenpflichtige Tools investieren sollten, um Bandbreite für Strategie und Audience-Engagement zurückzugewinnen.

Jetzt, da du ein klares Bild davon hast, welche Tools zu deinem Content-Creation-Stil passen, fassen wir zusammen, was wir behandelt haben, und helfen dir, die nächsten Schritte zu planen. Egal ob du gerade anfängst oder deine Clips-Operation skalierst – hier ist das Wichtigste, das du aus diesem Leitfaden mitnehmen solltest.

Fazit

Hier ist eine Zusammenfassung: Die KI-gestützte Clip-Extraktion beseitigt das größte Schmerzpunkt bei der Erstellung von Short-Form-Inhalten – die endlosen Stunden, die man damit verbringt, Videomaterial nach den besten Momenten zu durchsuchen. Moderne Tools scannen deine Videos in Sekunden und analysieren Audio, visuelle Elemente und Engagement-Muster anhand von Tausenden von viralen Benchmarks, um automatisch hochwertige Inhalte zu identifizieren.

Die eigentliche Kraft liegt in einem hybriden Workflow, der KI-gestützte Erkennung mit deinem menschlichen Urteilsvermögen kombiniert. Lass den Algorithmus die schwere Arbeit erledigen, und verfeinere dann basierend auf dem, was wirklich bei deinem Publikum ankommt.

Die Rechnung ist überzeugend. Kostenlose Tools funktionieren großartig zum Testen, aber die meisten Creator sehen bereits nach 1–2 Monaten ROI mit kostenpflichtigen Plänen, die Batch-Verarbeitung und Plattformoptimierung handhaben. Wenn du jährlich 200–300 Stunden sparst, ist das Zeit, die du in die Veröffentlichung weiterer Inhalte, das Erreichen größerer Zielgruppen und ehrlich gesagt – weniger Burnout – investieren kannst.

Hier ist dein nächster Schritt: Starten Sie mit einer kostenlosen Testversion von OpusClip oder StreamYard, um die KI-Moment-Erkennung mit deinem tatsächlichen Inhalte zu testen. Du wirst innerhalb von Minuten sehen, wie viel Aufwand dies spart. Bereit, deinen gesamten Workflow mit Untertiteln und Multi-Plattform-Formatierung zu automatisieren? Tools wie AutoShorts handhaben Batch-Verarbeitung nahtlos und ermöglichen es dir, dich auf die Strategie statt auf manuelle Bearbeitung zu konzentrieren.

Verfolge, welche KI-ausgewählten Clips auf jeder Plattform Engagement generieren, und verfeinere deine Parameter dann basierend auf echten Leistungsdaten.

Deine besten Clips sind bereits in deinen Videos – KI hilft dir einfach, sie schneller zu finden.

Häufig gestellte Fragen

Die KI-gestützte Momentenerkennung funktioniert durch gleichzeitige Analyse von Audiohinweisen (Sprechbetonung, Lachen, Tonveränderungen), visuellen Mustern (Gesichtsausdrücke, Szenenwechsel) und emotionalen Höhepunkten, die anhand Tausender viraler Clips trainiert wurden. Der Algorithmus sucht nach Engagemenzsignalen wie plötzlichen Stimmanstieigen, nachdenklichen Pausen, Text-Overlays und visuellen Überraschungen – im Grunde ahmt er nach, was ein professioneller Editor als würdig zum Clippen einstufen würde.

KI-Videoclip-Lösungen können einen 90-Minuten-Podcast, ein Webinar oder einen Livestream in unter 5 Minuten in Dutzende plattformfertige Clips umwandeln und sparen Erstellern bis zu 200 Stunden pro Jahr. Das, was traditionell 10-15 Stunden manuelle Suche und Bearbeitung dauern würde, ist jetzt automatisiert, sodass Sie sich auf Content-Strategie konzentrieren können, anstatt auf mühsame Bearbeitungsarbeit.

Nicht alle KI-Clip-Generatoren schneiden bei verschiedenen Content-Typen gleich gut ab – einige zeichnen sich durch die Identifizierung von Podcast-Momenten durch Audioanalyse aus, haben aber Schwierigkeiten mit Livestream-Dynamiken, bei denen visuelle Engagement-Höhepunkte wichtiger sind. Bei der Wahl eines Tools sollten Sie überprüfen, ob es für Ihren spezifischen Content-Typ optimiert ist, ob das Interview-basierte Podcasts, Bildungswebinare oder Entertainment-Livestreams sind.

Ja, moderne KI-Clip-Generator-Tools können Clips jetzt automatisch für TikTok, Instagram Reels, YouTube Shorts und LinkedIn mit einem Klick formatieren. Das bedeutet, dass Sie einen viralen Moment nehmen und ihn für das einzigartige Seitenverhältnis, die Längeanforderungen und Zielgruppenpräferenzen jeder Plattform optimieren können, ohne zusätzliche manuelle Bearbeitung.

Ein Hybrid-Workflow verbindet die automatische Momentenerkennung der KI mit menschlicher Kuratierung – der Algorithmus kennzeichnet potenzielle Clips, während Sie die Auswahl basierend auf Ihrer Markenidentität und Strategie überprüfen und verfeinern. Dieser Ansatz balanciert Effizienz mit Qualitätskontrolle und stellt sicher, dass der Algorithmus Momente erfasst, die Sie möglicherweise verpassen, während Sie die kreative Kontrolle über das behalten, was tatsächlich live geht.

KI analysiert mehrere Engagemenzsignale gleichzeitig: Audiobasierte Hinweise umfassen Änderungen der Sprechbetonung, Lachanfälle, Stille-Pausen und emotionale Tonveränderungen, während visuelle Komponenten Gesichtsausdrücke, Augenbewegungen, Text auf dem Bildschirm und animierte Grafiken erkennen. Wenn diese Signale ausgerichtet sind – wie wenn sich die Augen einer Person vor Überraschung erweitern und gleichzeitig eine Stimminflexion auftritt – kennzeichnet der Algorithmus dies als einen hochgradig engagierenden Moment, der würdig zum Clippen ist.