Découvrez comment l'IA détecte automatiquement et extrait les moments captivants des vidéos longues. Économisez plus de 200 heures par an grâce aux outils de découpe intelligents pour TikTok, Reels et Shorts.

Introduction au Blog

Vous venez de terminer l'enregistrement d'un podcast, d'un webinaire ou d'une diffusion en direct de 90 minutes. À l'intérieur se cachent des dizaines de moments dignes de devenir viraux, parfaits pour TikTok, Instagram Reels et YouTube Shorts. Mais voilà le problème—chercher manuellement ces pépites et les transformer en clips soignés ? C'est facilement 10 à 15 heures de travail que vous n'avez probablement pas dans votre semaine.

Et si nous vous disions que vous n'étiez pas obligé de le faire ?

Les outils de montage vidéo alimentés par l'IA analysent désormais automatiquement le contenu long format, identifient les moments captivants en fonction des indices audio et des motifs visuels, et génèrent des clips optimisés pour chaque plateforme en moins de 5 minutes. On parle d'économiser jusqu'à 200 heures par an tout en augmentant l'engagement de 12 % en moyenne—sans lever le petit doigt.

Mais voici ce que la plupart des créateurs ne réalisent pas : tous les outils de montage IA ne se valent pas. Certains excellent avec le contenu podcast mais échouent lamentablement sur les diffusions en direct. D'autres ratent les moments subtils qui génèrent vraiment des partages. Et de nombreux créateurs perdent du temps à lutter contre des workflows maladroits qui finissent par être plus lents que de le faire manuellement.

Dans ce guide, nous coupons à travers le battage médiatique. Vous apprendrez exactement comment la détection des moments par IA fonctionne réellement, quels outils livrent de vrais résultats pour votre type de contenu, et comment construire un workflow de montage qui peut être amplifié de votre premier téléchargement à la distribution sur chaque plateforme. C'est parti.

Maintenant que vous savez ce qui est possible, parlons de la magie derrière tout cela—car avant de pouvoir extraire ces moments précieux, vous devez comprendre comment l'IA les trouve réellement en premier lieu. Prêt à jeter un œil sous le capot ?

Comment l'IA détecte les moments captivants dans les longues vidéos

Vous avez des heures de rushes, et quelque part à l'intérieur se cache le prochain clip viral. La question qui se pose : comment l'IA le trouve-t-elle réellement ? Les algorithmes modernes de détection de moments fonctionnent comme des monteurs hautement qualifiés surcharges de caféine — ils analysent, examinent et identifient les pépites en quelques secondes. Au lieu de faire défiler aléatoirement l'intégralité de votre vidéo, l'IA utilise une combinaison d'analyse audio, de reconnaissance visuelle et d'appariement de motifs entraînée sur des milliers de clips viraux pour identifier précisément où la magie opère.

Comprendre les algorithmes de détection de moments par IA

Les outils de création de clips alimentés par l'IA analysent simultanément plusieurs couches de signaux. Selon Opus, la détection de moments fonctionne en examinant l'emphase du locuteur, les changements de rythme, le rire, les pauses de silence et les variations de ton émotionnel dans votre piste audio. Quand le présentateur élève soudainement la voix, s'arrête pour réfléchir, ou que la salle explose de rire, l'algorithme détecte ces changements comme des pics d'engagement potentiels.

Le système n'écoute pas seulement — il observe aussi. Les composantes de vision par ordinateur identifient les expressions faciales, les superpositions de texte à l'écran, les transitions de scène et les pics d'engagement visuel. Pensez-y : quand les yeux de quelqu'un s'élargissent de surprise ou que sa bouche s'ouvre, c'est un moment qui mérite d'être coupé. Le texte à l'écran, les graphiques animés qui apparaissent ou les coupes rapides de la caméra signalent tous du contenu conçu pour attirer l'attention.

Conseil Pro : Les meilleurs outils de création de clips IA combinent plusieurs méthodes de détection plutôt que de s'appuyer sur un seul signal. Cette approche multi-couches détecte les moments que la pure analyse audio ou la détection visuelle auraient manqués.

Ce qui rend un moment viral selon l'IA

C'est là que ça devient fascinant : les modèles d'IA entraînés sur des milliers de clips viraux sur diverses plateformes ont appris à reconnaître les motifs universels qui attirent l'attention. Ce ne sont pas des règles aléatoires — ce sont des motifs extraits du contenu qui performe réellement bien sur TikTok, Instagram Reels, YouTube Shorts et autres plateformes.

La recherche de Klap souligne que le système filtre le contenu superflu et identifie les moments à forte probabilité d'engagement en comparant avec les critères de référence des clips réussis. Mais voici la nuance : ce qui devient viral sur un podcast de comédie diffère de ce qui fonctionne sur une chaîne éducative. C'est pourquoi les algorithmes s'adaptent à différents types de contenu. Les interviews mettent en évidence les citations clés et les déclarations surprenantes. Le contenu éducatif souligne les explications claires et les moments « euréka ». Les clips de divertissement privilégient les réactions, les expressions et le timing comique.

Point Clé : L'IA ne détecte pas seulement les moments — elle comprend le contexte et la dynamique des plateformes, ce qui signifie qu'elle peut adapter les recommandations à votre type de contenu et à votre audience spécifique.

Pourquoi les signaux audio et visuels comptent

Ni l'audio ni les visuels seuls ne racontent l'histoire complète. Mais quand vous les combinez ? C'est là que la détection d'engagement devient puissante. La voix d'un locuteur peut changer pour indiquer qu'il s'apprête à dire quelque chose d'important, tandis que son expression faciale renforce le fait que c'est un moment pivot qui mérite d'être capturé.

La synergie entre ces signaux est ce qui rend le découpage IA moderne si efficace. Un rire soudain sans réaction visuelle pourrait n'être qu'un petit rire. Mais un rire combiné avec le visage de quelqu'un qui s'illumine et une légende qui apparaît à l'écran ? C'est un moment d'engagement garanti. En traitant ensemble les informations audio et visuelles, l'IA réalise ce qui prenait auparavant des heures d'examen manuel — identifier des dizaines de moments découpables en un seul passage.

- L'IA analyse le ton du locuteur, le rythme et les variations émotionnelles dans l'audio

- La vision par ordinateur identifie les expressions faciales et les transitions visuelles

- L'analyse multi-signaux détecte les moments que les méthodes de détection unique auraient manqués

- Les algorithmes apprennent des motifs de contenu viral sur les plateformes

- La détection s'adapte à votre type de contenu et à votre audience spécifique

Maintenant que vous comprenez comment la détection avancée fonctionne pour garder votre stratégie de contenu aiguisée, explorons les outils qui peuvent réellement créer ces clips dignes de devenir viraux. Nous avons testé les meilleurs générateurs de clips IA du marché, et nous sommes prêts à vous montrer lesquels méritent une place dans votre boîte à outils de contenu.

Les meilleurs outils générateurs de clips IA comparés

Le choix du bon outil de découpe IA dépend de votre type de contenu, de votre flux de travail et de vos objectifs de plateforme. Examinons les options exceptionnelles et ce qui rend chacune spéciale pour différents créateurs.

Meilleurs outils par cas d'usage

OpusClip domine le marché pour les créateurs en quête de moments viraux. Selon Opus, la plateforme analyse les tendances et les signaux d'engagement des spectateurs pour identifier automatiquement les segments les plus partageables de votre contenu. C'est parfait si vous produisez des podcasts ou des interviews longue durée où l'authenticité crée la viralité.

StreamYard excelle pour les créateurs de contenu en direct. Au lieu de parcourir vos enregistrements plus tard, vous pouvez littéralement dire « clip that » pendant votre direct, et la plateforme marque le moment en temps réel. Cette approche sans intervention manuelle réduit considérablement le temps de post-production.

VEED se distingue en post-production, offrant la génération automatique de sous-titres et l'export multi-format dans un seul flux de travail. Parfait pour les créateurs qui veulent des clips polis et professionnels sans se battre avec plusieurs outils.

Munch AI se spécialise dans le contenu longue durée comme les podcasts et les webinaires, en extrayant automatiquement les citations clés et les points de discussion qui fonctionnent naturellement comme des clips autonomes. Cutlabs vous économise plus de 4 heures par semaine en supportant les vidéos jusqu'à 8 heures avec une recherche de moments instantanée—idéal pour les animateurs de webinaires et les réseaux de podcasts.

Pro Tip : Testez 2-3 outils avec votre contenu réel avant de vous engager. Le « goût » IA de chaque outil varie légèrement selon ses données d'entraînement.

Vitesse et fonctionnalités d'automatisation

La recherche de Klap montre que la profondeur de l'automatisation varie considérablement selon les plateformes. Certains outils vous demandent de passer en revue les suggestions IA avant de finaliser les clips, tandis que d'autres livrent du contenu poli et prêt à poster en moins de 5 minutes.

L'avantage de vitesse dépend de la quantité que l'IA gère sans intervention humaine. Les outils qui génèrent automatiquement les sous-titres, ajoutent des transitions et appliquent les couleurs de la marque vous font gagner le plus de temps. Si vous traitez plusieurs vidéos par semaine, cela se traduit par des économies de temps considérables.

Capacités d'optimisation pour les plateformes

Chaque outil gère le formatage spécifique à la plateforme différemment—et bien le faire est crucial. TikTok exige des formats verticaux (9:16), Instagram Reels fonctionne mieux en carré 1:1, tandis que YouTube Shorts préfère le format paysage 16:9. Les meilleurs outils redimensionnent et recadrent automatiquement vos clips pour chaque plateforme sans perte de qualité.

Point clé : Certains outils exportent par lots les clips dans les trois formats simultanément, tandis que d'autres nécessitent une sélection manuelle. C'est une énorme différence quand vous réutilisez une longue vidéo sur plusieurs plateformes.

Maintenant que vous savez ce qu'il faut chercher dans un outil, voyons exactement comment mettre en place un flux de travail efficace du début à la fin. Je vous montrerai comment tirer parti de ces fonctionnalités pour transformer une vidéo en une puissance multi-plateforme en seulement quelques étapes.

Flux de travail étape par étape : du chargement à la distribution

Maintenant que vous avez choisi votre outil de découpage IA et compris le fonctionnement de la technologie, il est temps de passer à l'action. La beauté des générateurs de clips IA modernes, c'est que l'ensemble du flux de travail—du chargement de votre contenu longue forme à la publication sur plusieurs plateformes—est étonnamment simple. Parcourons ensemble chaque étape pour que vous puissiez commencer à transformer vos podcasts et webinaires de 90 minutes en clips prêts pour devenir viraux en quelques minutes, pas en heures.

Chargement et traitement de votre longue vidéo

C'est aussi simple que de faire un glisser-déposer. La plupart des outils de découpage IA supportent des fichiers vidéo jusqu'à 8 heures, ce qui couvre tout, des podcasts et webinaires aux diffusions en direct et aux enregistrements de conférences. Une fois que vous chargez le fichier, l'IA commence immédiatement à analyser votre contenu—pas d'attente pour des files d'attente de traitement qui prennent des jours.

Selon Opus, les outils IA modernes peuvent générer 10 à 30 suggestions de clips en quelques minutes en analysant les modèles audio, l'énergie de l'orateur, les réactions de l'audience et les transitions visuelles. Cette automatisation élimine le fastidieux scrubbing de timeline qui consommait autrefois des heures de temps d'éditeur. Votre rôle à cette étape ? Simplement attendre. L'IA fait le gros du travail.

Conseil pro : Téléchargez vos fichiers pendant les heures creuses si votre outil affiche des estimations de vitesse de traitement. Certaines plateformes priorisent les chargements en fonction de la charge du serveur.

Examen et personnalisation des clips générés par l'IA

C'est ici que le jugement humain brille de tout son éclat. L'IA a fait l'analyse, mais maintenant vous devenez le curateur. Examinez les clips suggérés et sélectionnez les moments qui résonnent vraiment avec votre marque et votre audience. C'est crucial—bien que l'IA soit remarquablement efficace pour repérer les pics d'engagement (changements de ton, rires, applaudissements), elle ne peut pas toujours comprendre le contexte ou votre stratégie de contenu spécifique.

Comme l'a souligné Klap, l'approche la plus efficace combine la détection IA avec la curation humaine. Vous pourriez remarquer que l'IA a signalé un moment drôle, mais elle a raté la chute suivante qui fonctionne vraiment mieux. C'est votre moment pour faire des ajustements manuels. Une fois que vous avez sélectionné vos gagnants, personnalisez chaque clip avec des introductions de marque, des sous-titres ajustés et des durées recadrées pour correspondre aux spécifications de chaque plateforme.

Point clé : L'IA manque rarement les pics d'engagement évidents, mais l'œil humain capture les moments nuancés qui rendent les clips vraiment viraux.

Optimisation pour plusieurs plateformes

Chaque plateforme a des préférences différentes. TikTok récompense les clips verticaux rapides de 15 à 60 secondes. Instagram Reels préfère des formats similaires mais avec des proportions légèrement différentes. YouTube Shorts fonctionne mieux avec 15 à 60 secondes en orientation verticale. LinkedIn demande un ton plus professionnel et des segments légèrement plus longs (30 à 90 secondes).

Au lieu de rééditer manuellement chaque clip pour chaque plateforme, les outils IA modernes vous permettent d'optimiser les clips pour plusieurs formats simultanément. Vous ajustez les sous-titres une fois, définissez vos directives de marque une fois, et l'outil reformate automatiquement pour les spécifications de chaque plateforme. C'est là que votre flux de travail s'accélère dramatiquement—ce qui prenait autrefois 3 à 4 heures prend maintenant 10 minutes.

- Sélectionnez vos plateformes cibles (TikTok, Instagram, YouTube Shorts, LinkedIn, etc.)

- Définissez les exigences de durée des clips propres à chaque plateforme

- Appliquez une marque cohérente à tous les formats

- Examinez les sous-titres générés automatiquement pour leur exactitude

- Ajustez le rythme et recadrez si nécessaire

Publication directe sur les canaux sociaux

L'étape finale est presque décevante par sa simplicité. La plupart des outils de découpage IA modernes offrent une publication multi-plateforme en un seul clic, ce qui signifie que vous pouvez envoyer vos clips polis directement à TikTok, Instagram, YouTube et LinkedIn sans jamais quitter l'outil. Pas de téléchargement, pas de changement d'applications, pas de ré-chargement de fichiers plusieurs fois.

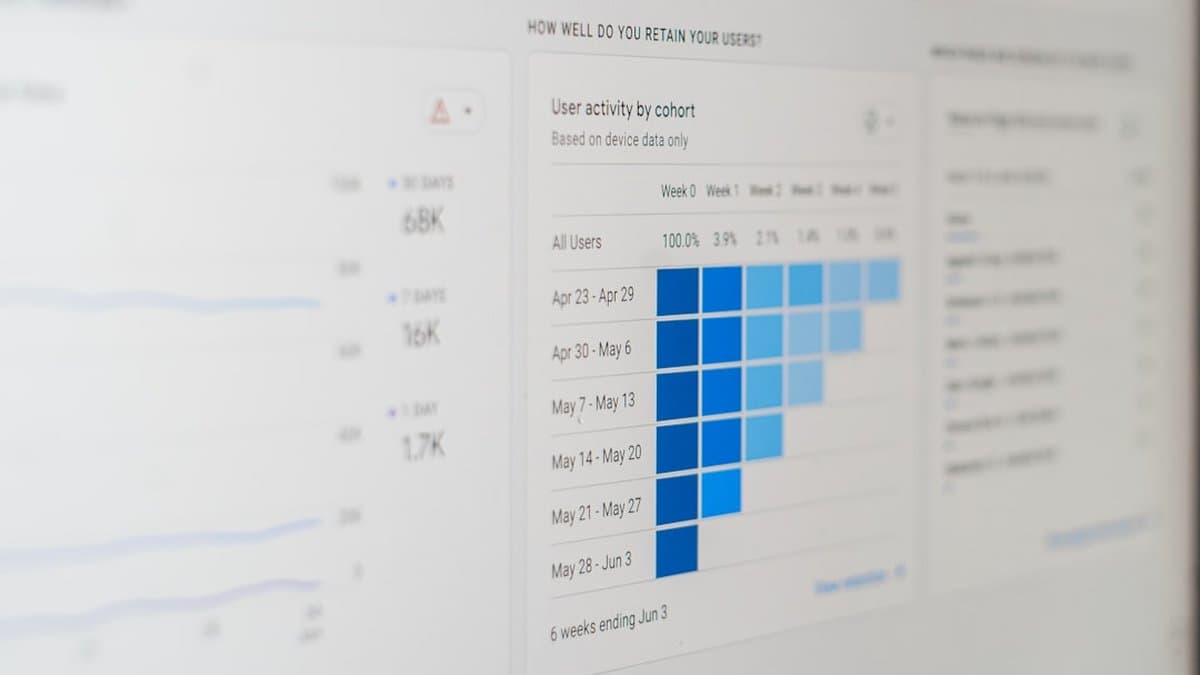

Après la publication, suivez les métriques de performance pour voir quels moments sélectionnés par l'IA génèrent réellement de l'engagement sur chaque plateforme. Cette boucle de rétroaction est inestimable—au fil du temps, vous commencerez à comprendre quels types de clips votre audience apprécie, et vous pourrez intégrer cette compréhension dans votre stratégie de contenu pour les futurs enregistrements longue forme.

Attention : Examinez toujours les sous-titres et la marque une dernière fois avant la publication. Les systèmes automatisés interprètent parfois mal la qualité audio ou le contexte, et vous voulez que vos clips soient impeccables avant leur mise en ligne.

Maintenant que vous avez vos clips individuels polis et prêts, parlons de comment maintenir ce même niveau de qualité dans tout votre contenu au fur et à mesure que vous commencez à en produire davantage. Nous explorerons quelques systèmes et stratégies pratiques qui vous aident à conserver votre voix de marque et vos normes vidéo, même quand vous jonglerez avec plusieurs projets à la fois.

Maintenir la qualité et la cohérence de marque à grande échelle

Voici la réalité : l'IA est incroyablement puissante pour détecter les moments captivants, mais vous êtes toujours aux commandes. Les meilleurs créateurs n'acceptent pas simplement ce que l'algorithme génère—ils utilisent l'IA comme un partenaire créatif qui gère le travail difficile tandis qu'ils conservent le contrôle créatif total. Lorsque vous découpez des dizaines de vidéos par mois, cette approche hybride devient essentielle pour évoluer sans sacrifier ce qui rend votre marque unique.

L'approche hybride humain-IA

Considérez la détection de moments IA comme votre assistant de recherche infatigable. Elle observe chaque seconde de votre contenu, signale les clips potentiels et vous les présente pour examen. Mais c'est là que votre expertise entre en jeu : vous décidez ce qui est réellement publié. Selon Async, les créateurs qui mettent en œuvre ce flux de travail d'examen et d'approbation maintiennent des normes de qualité considérablement plus élevées dans l'ensemble de leurs bibliothèques de contenu tout en réduisant dramatiquement le temps de production.

Le flux de travail est simple. Après que l'IA génère les suggestions de clips, passez 15-20 minutes à les examiner avec des yeux frais. Posez-vous : Ce clip représente-t-il ma marque avec précision ? L'audio est-il clair ? Y a-t-il un crochet fort dans les trois premières secondes ? Correspond-il aux attentes de mon audience ? Cette porte de contrôle de qualité rapide empêche le contenu médiocre de nuire à votre réputation, même lorsque vous produisez à grande échelle.

Conseil professionnel : Regroupez vos sessions d'examen en blocs de temps dédiés plutôt que de vérifier les clips tout au long de la journée. Vous prendrez des décisions plus rapides et plus cohérentes lorsque vous êtes en « mode édition ».

Configurer des paramètres de détection personnalisés

Tout contenu n'est pas créé égal, et vos paramètres IA ne devraient pas l'être non plus. Un discours motivant nécessite une sensibilité de découpe différente d'un podcast comique—l'un pourrait avoir besoin de moments plus longs et plus réfléchis tandis que l'autre prospère sur des blagues rapides. Selon Opus, la personnalisation des paramètres de détection en fonction de votre type de contenu est l'une des fonctionnalités les plus sous-utilisées disponibles pour les créateurs.

Commencez par expérimenter avec les niveaux de sensibilité. Le contenu éducatif bénéficie souvent d'une sensibilité moyenne (attraper ces moments « eurêka ! » sans sur-découper), tandis que le contenu de divertissement pourrait utiliser une sensibilité élevée pour capturer chaque rire et réaction. Au-delà de la sensibilité, vous pouvez personnaliser :

- Durée minimale du clip (par exemple, 15-60 secondes selon la plateforme)

- Durée maximale du clip pour éviter les segments qui s'éternisent

- Exclusions de mots-clés (exclure les clips mentionnant des noms de concurrents ou des sujets sensibles)

- Filtres de sujet (prioriser les clips sur votre domaine principal)

- Seuils de qualité audio (rejeter les clips avec du bruit de fond au-dessus de certains niveaux)

Passez une après-midi à tester ces paramètres sur 2-3 vidéos représentatives. Une fois que vous trouvez votre équilibre, enregistrez ces configurations comme modèles que vous pouvez appliquer aux futurs téléchargements en quelques secondes.

Point clé : Vos paramètres de détection doivent évoluer au fur et à mesure que votre audience et votre marque se développent. Examinez-les et ajustez-les trimestriellement en fonction des clips qui obtiennent réellement le plus d'engagement.

Créer une liste de contrôle de la qualité du contenu

La cohérence est l'ingrédient secret qui sépare les marques que les gens font confiance de celles qui semblent éparpillées. Lorsque vous produisez plusieurs clips par semaine, une liste de contrôle de qualité détaillée prévient la dérive. Votre liste de contrôle doit couvrir chaque élément visuel, audio et de messagerie qui définit votre marque.

Créez un document qui inclut :

- Styles d'intro/outro : Utilisez-vous toujours le même graphique de 3 secondes ? La même musique de fond ?

- Étalonnage des couleurs : Tous les clips utilisent-ils la même LUT (Look-Up Table) ou le même profil de couleur ?

- Formatage des sous-titres : Police, taille, couleur et positionnement cohérents dans tous les clips

- Sélections musicales : Bibliothèque de pistes approuvées avec licences confirmées

- Ton de la messagerie : Directives de voix de marque (formel vs. casual, niveau d'humour, vocabulaire)

- Normes d'appel à l'action : Où les CTA apparaissent, ce qu'ils disent, conception visuelle

Avant de publier un clip, exécutez-le à travers cette liste de contrôle. Cela prend 60 secondes et prévient le moment « ce n'est pas vraiment notre marque » qui tue la confiance des spectateurs.

Avertissement : Sauter la liste de contrôle pour gagner du temps presque toujours se retourne contre vous. L'image de marque incohérente fait paraître votre entire bibliothèque de contenu moins professionnelle, même si les clips individuels sont excellents.

Une dernière stratégie : traiter plusieurs vidéos en lot simultanément. Téléchargez 5-10 vidéos dans votre outil IA à la fois, laissez-les tous se traiter pendant la nuit, puis passez 2-3 heures le lendemain matin à examiner tous les clips générés et appliquer votre liste de contrôle. Ce flux de travail est meilleur que de traiter une vidéo à la fois car vous êtes dans un état d'esprit focalisé et efficace.

Ne jetez pas non plus les clips rejetés. Archivez-les dans un dossier séparé. La recherche montre que les clips que l'IA a signalés comme captivants mais que vous avez rejetés représentent souvent un véritable intérêt de l'audience—ce sont des mines d'or de contenu pour les vidéos futures ou les tests A/B de différents styles auprès de votre audience.

Maintenant que vous comprenez comment identifier et exploiter ces opportunités de contenu cachées, parlons du côté pratique des choses—car découvrir des mines

Analyse des coûts : outils gratuits vs payants et considérations de ROI

Voici la vraie question : La mise à niveau a-t-elle vraiment un sens financier pour votre flux de travail ? La réponse dépend de votre volume de contenu, de votre fréquence de publication et de la valeur que vous accordez à votre temps. Analysons les chiffres pour que vous puissiez prendre une décision qui aura vraiment un impact sur votre activité.

Limitations de la version gratuite

Les générateurs de clips IA gratuits semblent attrayants jusqu'à ce que vous atteigniez leur plafond. Selon Opus, les outils gratuits comme certaines versions de VEED et OpusClip génèrent généralement seulement 3 à 5 clips par mois avec des filigranes apposés sur votre vidéo—un véritable problème si vous essayez de maintenir une marque professionnelle. Vous serez également confronté à des options de personnalisation limitées, des temps de traitement plus lents et un nombre minimal d'analyses pour comprendre ce qui fonctionne réellement.

Le problème des filigranes à lui seul peut nuire à votre crédibilité. Les outils gratuits limitent également les endroits où vous pouvez exporter les clips et imposent souvent une limite de durée ou de taille de fichier pour l'importation de vidéo. Pour les créateurs occasionnels de contenu qui testent les eaux, ces limitations pourraient être tolérables. Mais dès que vous êtes sérieux dans votre évolution, vous ressentirez les contraintes.

Attention : Les filigranes de la version gratuite peuvent gravement endommager votre crédibilité professionnelle, surtout si vous proposez vos services à des clients ou construisez une marque personnelle.

Plans payants et modèles de tarification

Les plans payants coûtent généralement entre 20 € et 99 € par mois, selon la plateforme et l'ensemble des fonctionnalités. À ce niveau, vous débloquez une génération de clips illimitée, des vitesses de traitement prioritaires, des tableaux de bord analytiques avancés et des options sans marque qui éliminent tout le branding. La recherche menée par Oreate AI souligne que les outils payants de niveau intermédiaire sont le juste équilibre pour la plupart des créateurs et petites agences, offrant une fonctionnalité sérieuse sans tarification de niveau entreprise.

Si vous gérez plusieurs comptes de créateurs ou avez besoin de flux de travail d'approbation centralisés, les solutions d'entreprise (500 € +/mois) fournissent des intégrations personnalisables et un support dédié. L'augmentation des prix reflète l'échelle—ces plans gèrent 50+ clips par semaine entre différents membres de l'équipe.

Plan gratuit

3-5 clips/mois Filigrane Fonctionnalités basiques Support limité

Plan standard payant

20-99 €/mois Clips illimités Analyses avancées Traitement prioritaire

Entreprise

500 €+/mois Gestion d'équipe Flux de travail personnalisés Support dédié

Calculer votre ROI en gains de temps

C'est là que les mathématiques deviennent convaincantes. Si l'IA vous fait économiser 4 heures par semaine—du temps passé à éditer et exporter manuellement les clips—cela se traduit par environ 160 € à 400 € par mois en temps récupéré, selon votre taux en tant que pigiste ou créateur. La plupart des outils payants se rentabilisent en un seul mois grâce aux seuls gains de temps.

Disons que vous êtes un pigiste facturant 50 €/heure et qu'un outil payant coûte 50 €/mois. S'il vous économise ne serait-ce qu'une heure par semaine, vous vous êtes amortis. Tout gain de temps au-delà de cela est du pur profit. Pour les créateurs qui publient 10+ clips par semaine, la mise à niveau n'est pas optionnelle—elle est essentielle à l'efficacité de votre flux de travail.

Conseil professionnel : Calculez votre taux horaire, multipliez-le par le nombre d'heures économisées par semaine, puis comparez cela au coût mensuel de l'outil. Si les heures économisées dépassent l'abonnement, mettez à niveau immédiatement.

L'équation est simple : les éditeurs occasionnels (moins de 5 clips par semaine) peuvent facilement rester avec des options gratuites, tandis que les créateurs de contenu actifs devraient investir dans des outils payants pour récupérer de la bande passante pour la stratégie et l'engagement de l'audience.

Maintenant que vous avez une vision claire des outils qui correspondent à votre style de création de contenu, finissons par résumer tout ce que nous avons couvert et vous aider à décider de vos prochaines étapes. Que vous commenciez tout juste ou que vous agrandiissiez votre opération de clips, voici ce que vous devriez retenir de ce guide.

Conclusion

Voici ce que nous avons couvert : l'extraction de clips par IA élimine le plus grand obstacle dans la création de contenu court—ces interminables heures à fouiller dans les vidéos pour trouver les meilleurs moments. Les outils modernes analysent vos vidéos en quelques secondes, en étudiant l'audio, les éléments visuels et les modèles d'engagement comparés à des milliers de repères viraux pour faire émerger automatiquement du contenu de qualité.

Le vrai pouvoir ? Un flux de travail hybride qui combine la détection par IA avec votre jugement humain. Laissez l'algorithme faire le gros du travail, puis affinez en fonction de ce qui résonne vraiment avec votre audience.

Les chiffres sont convaincants. Les outils gratuits fonctionnent très bien pour tester, mais la plupart des créateurs voient un ROI en 1-2 mois avec des plans payants qui gèrent le traitement par batch et l'optimisation multi-plateforme. Quand vous économisez 200-300 heures par an, c'est autant de temps redirigé vers la publication de plus de contenu, l'atteinte d'audiences plus larges, et honnêtement—le burn-out bien moins intense.

Voici ce qu'il faut faire ensuite : Commencez par un essai gratuit sur OpusClip ou StreamYard pour tester la détection de moments IA avec votre vrai contenu. Vous verrez en quelques minutes combien de bande passante cela vous économise. Prêt à automatiser entièrement votre flux de travail avec sous-titres et formatage multi-plateforme ? Des outils comme AutoShorts gèrent le traitement par batch sans effort, vous permettant de vous concentrer sur la stratégie plutôt que sur l'édition manuelle.

Suivez les clips sélectionnés par l'IA qui génèrent l'engagement sur chaque plateforme, puis affinez vos paramètres en fonction des véritables données de performance.

Vos meilleurs clips sont déjà dans vos vidéos—l'IA vous aide simplement à les trouver plus vite.

Questions fréquentes

La détection de moments alimentée par l'IA fonctionne en analysant simultanément les indices audio (emphase du locuteur, rires, changements de ton), les modèles visuels (expressions faciales, transitions de scènes) et les pics émotionnels entraînés sur des milliers de clips viraux. L'algorithme recherche les signaux d'engagement tels que les augmentations soudaines de la voix, les pauses réfléchies, les superpositions de texte à l'écran et les surprises visuelles—essentiellement en imitant ce qu'un éditeur professionnel marquerait comme valant la peine d'être extrait.

Les solutions de montage vidéo par IA peuvent transformer un podcast de 90 minutes, un webinaire ou un livestream en des dizaines de clips prêts pour la plateforme en moins de 5 minutes, économisant aux créateurs jusqu'à 200 heures par an. Ce qui prendrait traditionnellement 10 à 15 heures de recherche et d'édition manuelles est désormais automatisé, vous permettant de vous concentrer sur la stratégie de contenu plutôt que sur un travail d'édition fastidieux.

Tous les générateurs de clips par IA ne fonctionnent pas de manière égale selon les types de contenu—certains excellent à identifier les moments de podcast par analyse audio mais ont du mal avec la dynamique des livestreams où les pics d'engagement visuels sont plus importants. Lors du choix d'un outil, vérifiez qu'il est optimisé pour votre type de contenu spécifique, qu'il s'agisse de podcasts basés sur des entretiens, de webinaires éducatifs ou de livestreams de divertissement.

Oui, les outils générateurs de clips par IA modernes peuvent désormais formater automatiquement les clips pour TikTok, Instagram Reels, YouTube Shorts et LinkedIn en un seul clic. Cela signifie que vous pouvez prendre un moment viral et l'optimiser pour le rapport d'aspect unique de chaque plateforme, les exigences de durée et les préférences du public sans édition manuelle supplémentaire.

Un flux de travail hybride associe la détection de moments automatisée par l'IA avec une curation humaine—permettant à l'algorithme de signaler les clips potentiels tandis que vous examinez et affinez les sélections en fonction de votre voix de marque et de votre stratégie. Cette approche équilibre l'efficacité avec le contrôle de qualité, garantissant que l'algorithme détecte les moments que vous pourriez manquer tandis que vous maintenez la supervision créative sur ce qui est réellement diffusé.

L'IA analyse simultanément plusieurs signaux d'engagement : les indices basés sur l'audio incluent les changements d'emphase du locuteur, les rafales de rires, les pauses de silence et les changements de ton émotionnel, tandis que les composantes visuelles détectent les expressions faciales, les mouvements des yeux, le texte à l'écran et les graphiques animés. Lorsque ces signaux s'alignent—comme les yeux de quelqu'un s'élargissant de surprise coïncidant avec une inflexion de voix—l'algorithme le signale comme un moment d'engagement élevé valant la peine d'être extrait.